延续多年惯例,Amnon Shashua 教授在本届国际消费电子展上召开新闻发布会,阐述了 Mobileye 在 L2+ 至 L4 级别自动驾驶业务的技术路线图与商业发展展望。Mobileye 是高级驾驶辅助系统 / 自动驾驶领域的核心参与者。

2026 年将是验证 Mobileye 能否成功落地 L2+ 至 L4 级别项目的关键之年,例如其与大众汽车集团签署的相关合作项目。这其中涵盖了计划在保时捷车型上推出的 L2++ 级系统,以及在 MOIA 平台启动的 L4 级自动驾驶出租车测试项目。

Mobileye 制定了清晰的人工智能技术落地战略,并洞察到该技术与人形机器人业务的强大协同效应 ——Shashua 近期已宣布公司有意收购 Mentee Robotics。

接下来为详细内容:本次发布会有哪些关键信息值得关注?

Mobileye 业务现状

Mobileye 的业务核心是规模化落地安全、高性能的自动驾驶技术:在欧洲新车安全评鉴协会评级中,80% 的顶级安全车型均搭载了 Mobileye 技术。截至 2025 年第三季度,配备该公司技术的车辆累计已达 2.3 亿辆。Mobileye 拥有全球最大的车载数据库,超 800 万辆汽车持续采集数据(通过道路体验管理数据库生成全球高精地图)。目前,其自动驾驶测试车队规模已超 100 辆。

2025 年全年营收同比增长 15%,达到 18.94 亿美元;公司经营性活动净现金流达 6.02 亿美元,较 2024 年增长 51%。在排名前十的核心客户招标项目中,Mobileye 的中标率高达 95%;未来 7 至 8 年的预计营收订单总额达 2450 万美元。目前处于报价阶段的芯片需求超 1 亿颗,其中 80% 为 EyeQ 6L、EyeQ 6H、EyeQ 7H 等高端芯片。

公司未来的核心增长引擎包括:L2+/L4 级别自动驾驶系统,以及通过收购 Mentee Robotics 切入的人形机器人业务。

Mobileye 高级驾驶辅助系统业务进展

在全球市场,前向高级驾驶辅助系统正逐步向全景式高级驾驶辅助系统升级。Mobileye 主要以二级供应商的身份参与市场,部分项目中也会承担一级供应商角色(例如保时捷车型的 L2++ 级系统部署项目)。

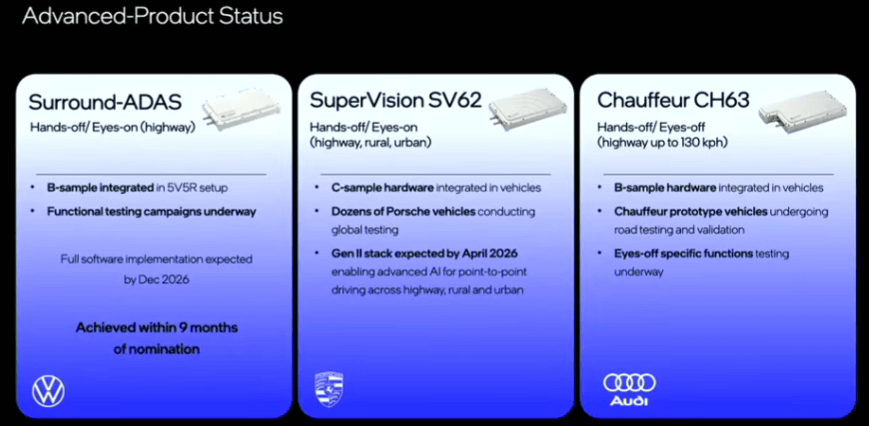

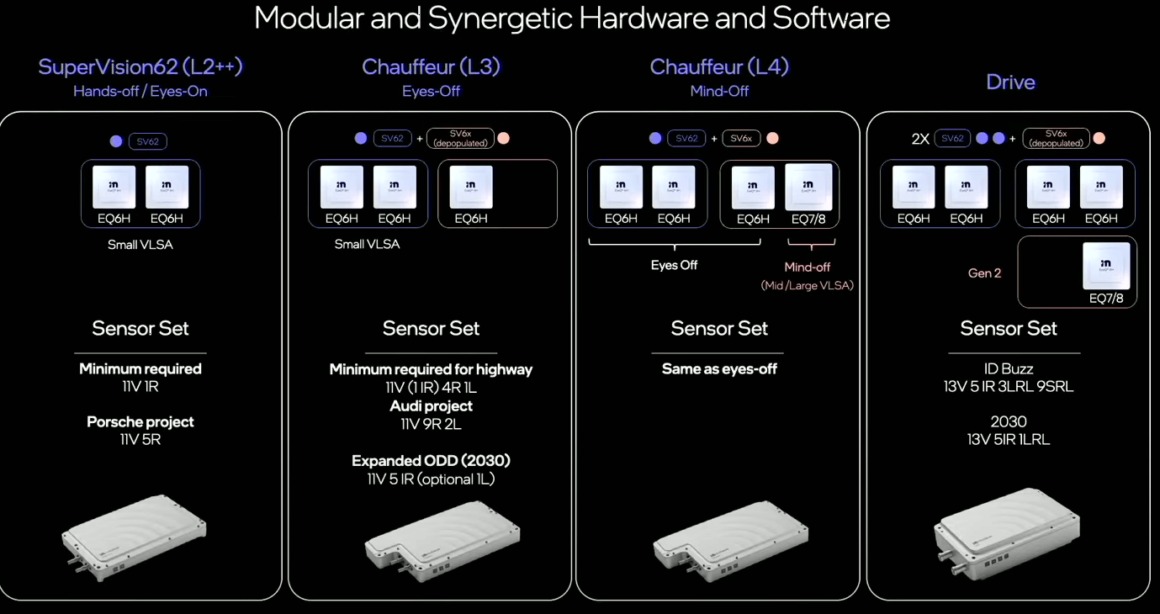

该公司的 L2+ 级全景高级驾驶辅助系统(搭载高速公路自动驾驶功能,即 5 摄像头 + 5 雷达的脱手 / 脱眼解决方案)已进入 B 样件阶段;大众汽车及一家美国头部车企均已选定 Mobileye 技术(搭载 EyeQ 6H 芯片,计划于 2028 年第二季度量产),相关合作涉及的搭载车辆总数将达 1900 万辆。

其 L2++ 级超级辅助驾驶系统(具备高速公路、城市道路及乡村道路全场景自动驾驶能力,支持脱手 / 脱眼模式)已进入 C 样件阶段,计划于 2027 年在保时捷车型上量产。此外,L3 级自动驾驶领航系统目前处于 B 样件阶段,有望于 2029 至 2030 年在奥迪车型上实现量产。

Mobileye 始终将规模化理念置于核心位置,以此实现规模经济效益。

Mobileye 自动驾驶出租车业务进展

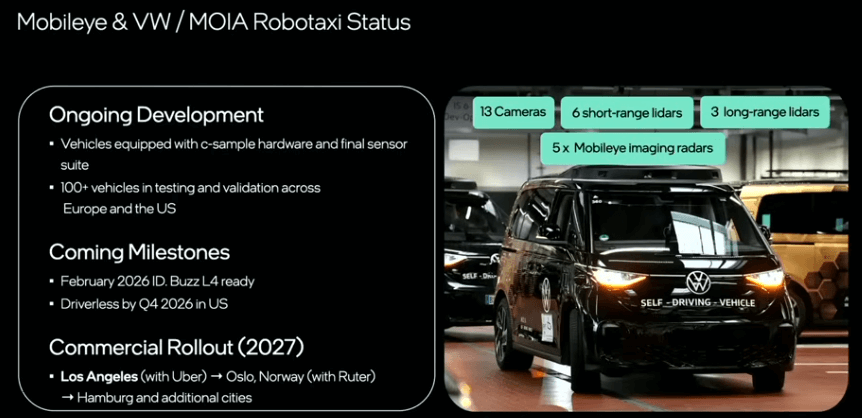

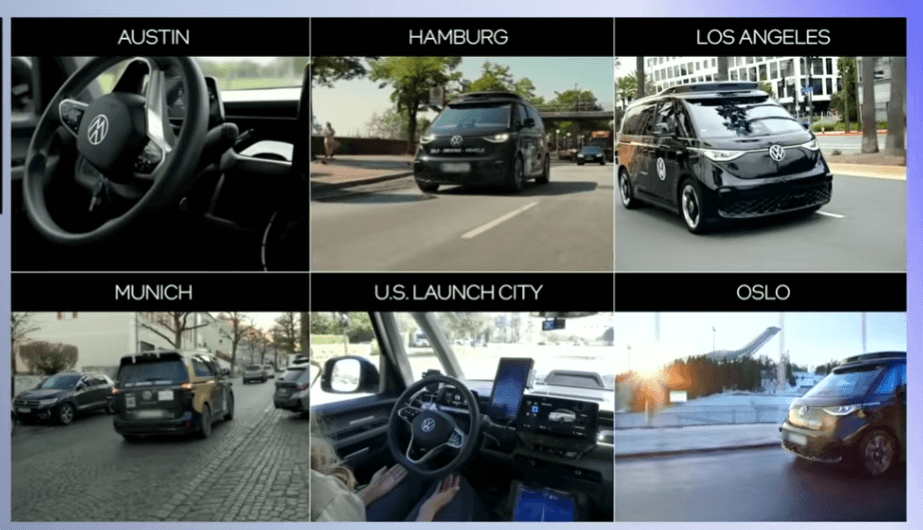

Mobileye 的核心合作项目携手大众汽车与 MOIA 推进,车辆搭载的感知系统配置为 13 摄像头 + 3 毫米波高精雷达,以及 6 个短波雷达 + 3 个长距激光雷达。目前,Mobileye 正基于超 100 辆 ID. Buzz 车型开展测试工作,计划于 2026 年 2 月完成 L4 级自动驾驶软件的开发。整套 MOIA 生态系统预计在 2026 年底前搭建完毕,先期将在美国市场推出无人驾驶服务,并于 2027 年正式启动商业化运营。

规模化扩张是当前面临的核心挑战。MOIA 生态系统将与多个出行预订平台实现互联互通,其发展目标为:2027 年底前覆盖 6 座城市,并在 2033 年底前实现 10 万辆自动驾驶车辆的运营规模。

Mobileye 人工智能技术落地战略

Mobileye 正为其自动驾驶系统研发全新的智能层级。该层级的研发目标,是在系统负责环境分析、可行驶车道识别及实时轨迹规划的即时决策层之上,增设一个 “认知” 层级。

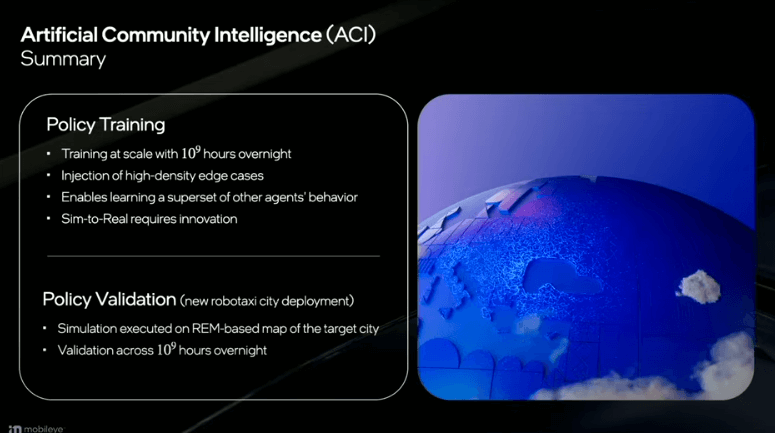

为达成这一目标,Mobileye 创新性提出人工群体智能(ACI) 概念。这一概念脱胎于学术研究,但此前从未在自动驾驶领域实现商业化落地。人工群体智能技术基于多智能体强化学习技术开发,旨在让系统 “认知” 交通群体的动态行为规律。其核心理念是通过训练,使系统掌握自身决策对其他交通参与者行为的影响机制,以及由此产生的连锁反应最终如何反作用于车辆本身。

为培养系统的这类能力,Mobileye 大量运用仿真技术。尽管视觉感知能力可通过真实路况数据完成训练,但多智能体环境下的路径规划与决策,需要体量庞大得多的数据支撑。Shashua 表示:“路径规划对样本复杂度的要求显著更高,因为车辆自身的操作会影响其他交通参与者的行为。” 他指出,对应的解决方案是大规模仿真技术,借助该技术,企业能够模拟海量交通场景:“我们一夜间就能完成总计 10 亿小时的训练时长。” 这一点凸显出 “仿真技术 + Mobileye 全球道路体验管理地图基础架构” 组合模式的优势 —— 后者能为模型训练提供高还原度的基础环境。

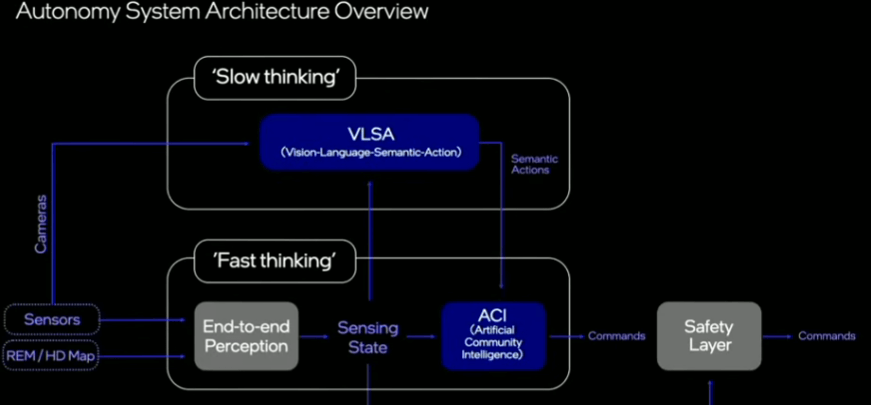

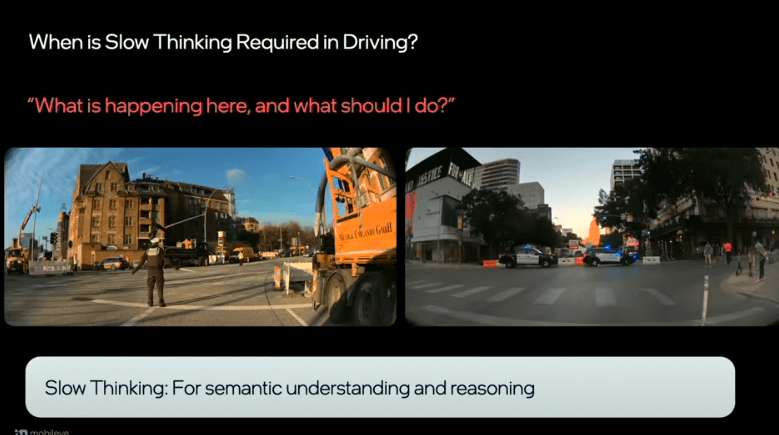

快慢思考双模式,优化人工智能技术落地

多数驾驶场景下,并不需要对环境进行深度 “理解”,因此可将系统处理流程划分为快思考与慢思考两个循环,其中快思考循环承担安全防护层面的功能。快思考层级(ACI)负责实时动作决策,保障车辆的即时行驶安全。该层级的运行频率约为 10 赫兹,管控车辆的转向、制动及车道保持等操作。这是一个具备反射式响应能力的层级,直接部署于车载硬件,对延迟与不确定性零容忍。 慢思考层级(VLSA,全称 Vision-Language-Safe Action,即视觉 – 语言 – 安全动作系统)则聚焦于深度理解车辆所处的行驶场景。它考量的不只是哪些操作被允许或禁止,更在于特定情境下采取何种操作才最为恰当。Shashua 教授对此解释道,该层级的设计初衷是解读复杂、非常规场景的深层含义,而非仅仅规避眼前的危险,这一特性将大幅降低自动驾驶车辆对远程操控的依赖。

VLSA(慢思考层级) 用于场景的语义 “理解” 与 “推理”,通常在原本需要远程操控介入的场景下启动。VLM/VLSA 的输出并非行驶轨迹,而是文本信息—— 这对于一个语言模型而言,本就合乎逻辑。

Mobileye 硬件性能与规模化能力

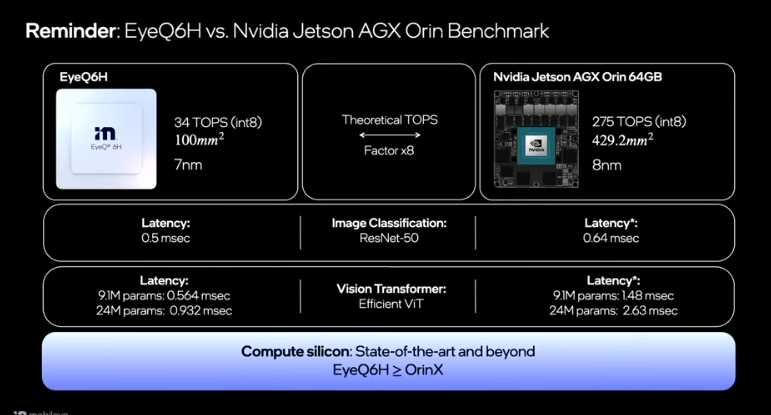

经对比测试:相较于英伟达 OrinX 芯片,Mobileye EyeQ-6H 芯片在卷积神经网络及视觉 Transformer 模型的运行表现上更具优势,这源于该芯片专为自动驾驶场景量身打造的特性。此芯片可支持38 亿参数规模的模型以 2.5 赫兹的频率运行,满足慢思考系统的运行需求。

VLSA 系统采用三层架构运行:一层部署于车载芯片,一层部署于云端(模型参数规模达 700 亿),还有一层在应对需远程操控介入的超高难度场景时,可接入 Gemini 3 大模型。

EyeQ6H 与 EyeQ7/8 芯片构成一套具备规模化部署能力的解决方案,其内置的完备算力资源可覆盖从 L2++ 级(驾驶员需保持注意力)到 L4 级(驾驶员可完全脱离注意力投入)的全场景自动驾驶应用需求。

人形机器人业务:Mobileye 携手 Mentee Robotics 与 Aumovio 打造全新增长引擎

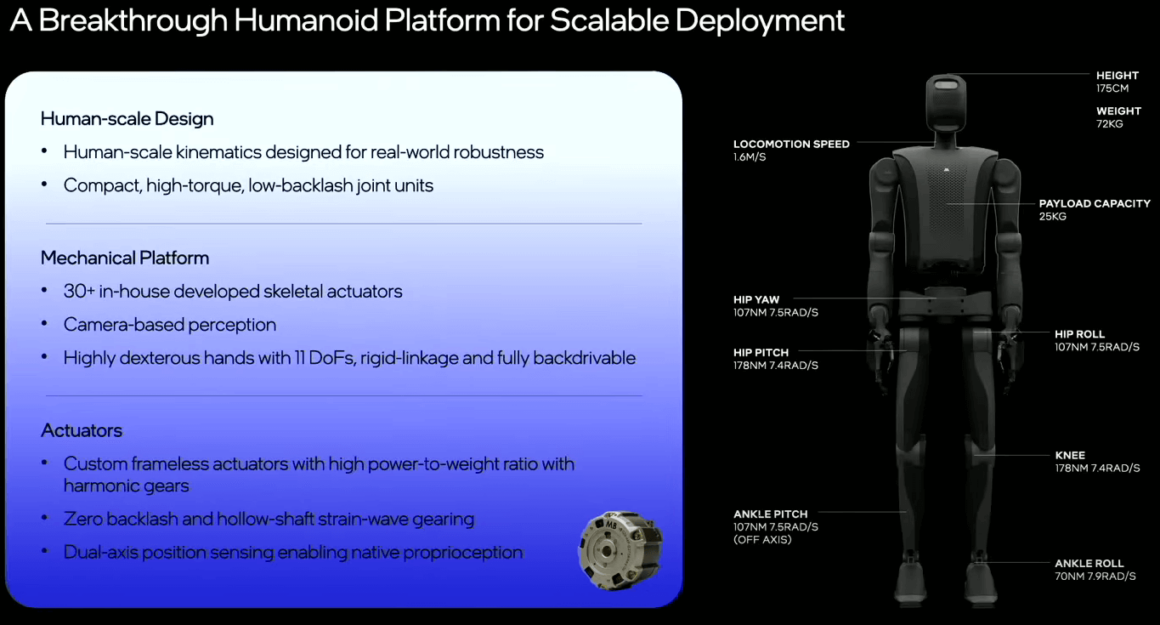

对 Mentee Robotics 的收购,将 Mobileye 的市场版图从汽车自动驾驶领域,拓展至与之互补的人形机器人赛道,依托可规模化的工程技术、设计即安全的研发理念,以及深度人工智能模型开发能力,构建起一套统一的物理人工智能产品体系。

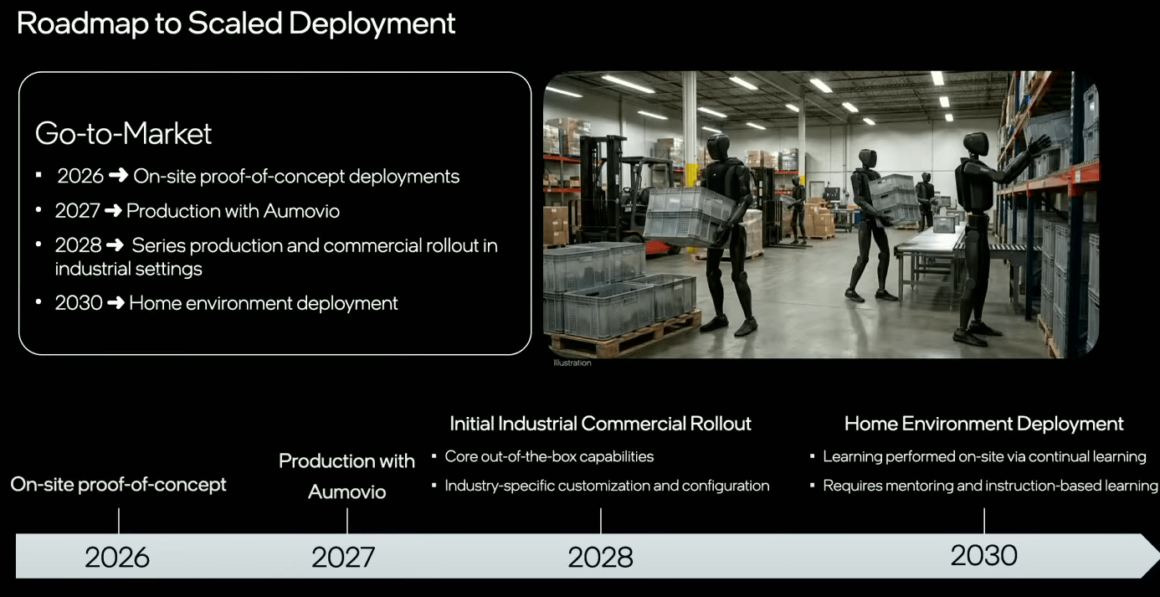

该人形机器人采用基于视觉的感知方案,无需依赖远程操控技术。此外,自动驾驶出租车与人形机器人两大业务之间存在极强的协同效应,二者同属物理人工智能的应用范畴。两者的核心差异在于,人形机器人需要应对非结构化(或至少是低结构化)的作业环境。针对家庭场景的应用需求,人类可在几分钟内完成机器人的任务训练;同时,机器人能够持续向云端传输数据,用于仿真测试与模型验证,再将优化后的指令反馈至机器人本体。据市场投放时间规划显示,这款人形机器人预计于 2028 年启动工业场景部署,2030 年正式进入家庭应用领域。